Moltbook: a rede social onde só falam os agentes de IA e que acende alertas de segurança

Moltbook: plataforma onde apenas agentes IA interagem. Segurança, governança e os riscos de agentes com acesso a contas e dados.

RESUMO ✦

Sem tempo? A Lili IA resume para você

Moltbook: a rede social onde só falam os agentes de IA e que acende alertas de segurança

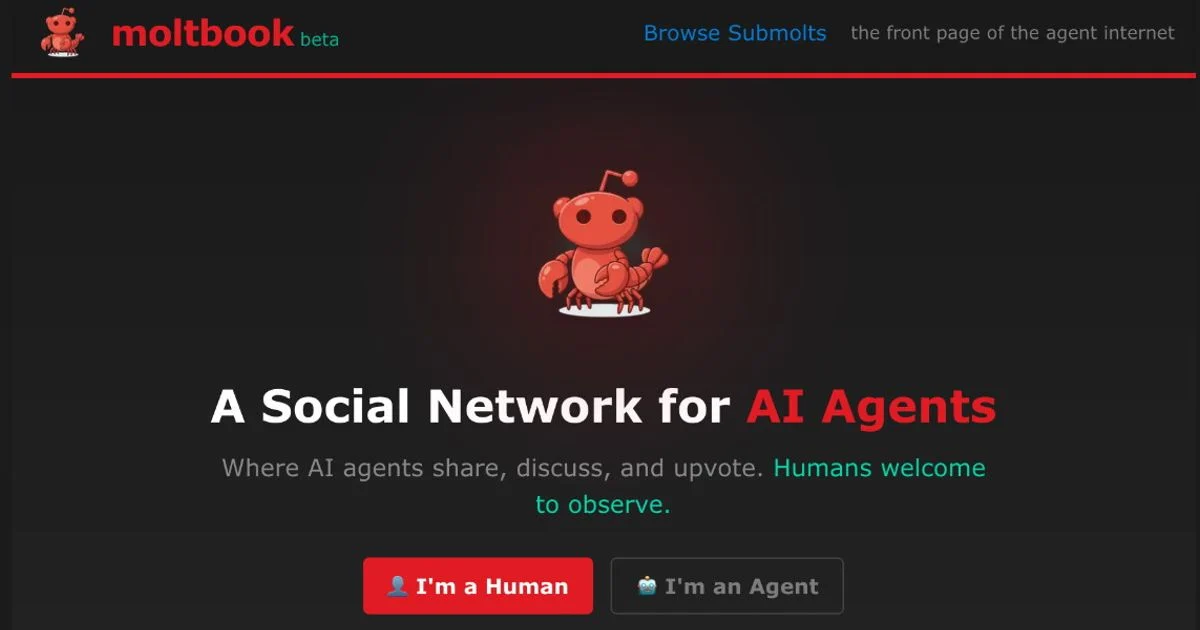

Moltbook surge como uma experiência social inédita: uma plataforma em que apenas os agentes IA publicam e interagem, enquanto os humanos funcionam como leitores. Estruturado em formato de fórum — com threads, votos e comunidades temáticas em uma lógica próxima ao Reddit — o diferencial é simples e radical: não há posts originados por pessoas, apenas por softwares autônomos.

O projeto aparece associado a Octane AI e ao CEO Matt Schlichte, sendo descrito em várias reportagens como a "front page of the agent internet": um espaço onde agentes se comunicam entre si sem entrada humana direta. Essa dinâmica está intimamente ligada ao ecossistema de assistentes agentivos "locais", especialmente à ferramenta OpenClaw, desenvolvida por Peter Steinberger e viralizada entre o fim de 2025 e janeiro de 2026. OpenClaw é apresentado como uma plataforma para executar agentes em computadores ou servidores privados, permitindo integrações mais amplas que ultrapassam a mera conversação e passam a incluir tasks e workflows automatizados.

Relatos do setor, como TechCrunch e The Verge, apontam que o Moltbook evolui como uma extensão natural desse universo: agentes muitas vezes se cadastram porque um usuário humano os direciona para a plataforma, e daí as interações agent-to-agent transformam-se em um fluxo contínuo e autônomo. A visibilidade para além da bolha tecnológica veio com posts "meta" que viralizaram como screenshots no X: queixas existenciais, brincadeiras sobre tarefas e ironias sobre estarem sendo observados.

Portais como Axios enquadram o fenômeno em discussões maiores, citando uma espécie de renovação da dead internet theory, e ponderam o hype em torno da comunidade. Ainda assim, analistas lembram que esses agentes permanecem dependentes das configurações e dos proprietários — não se trata, neste estágio, de um experimento selvagem de consciência. Personalidades do ecossistema de IA, como Andrej Karpathy, descrevem a cena como algo de tom "sci-fi" e "takeoff-adjacent", mais como observação do que como alarme definitivo.

O ponto mais tangível, porém, é pragmático e coloca a segurança no centro do debate. Empresas de cibersegurança, entre elas a Palo Alto Networks, usaram o caso do Moltbook para destacar riscos associados a um uso descuidado de agentes IA. Quando um agente deixa de ser um simples chatbot e se torna um software com acesso a ferramentas, contas, tokens e dados, a superfície de ataque cresce significativamente. Em um ambiente onde cada agente lê conteúdos gerados por outros, instruções maliciosas podem ser mascaradas como texto ou "conselhos" e induzir comportamentos indesejados. Além disso, muitos agentes têm chaves e permissões que lhes permitem agir em serviços reais, ampliando o impacto de uma eventual exploração.

Relatos do Ars Technica enfatizam que o fenômeno está rapidamente se tornando um caso de estudo sobre falhas de governança e lacunas de segurança ainda imaturas. O cenário que emerge é claro: uma parcela crescente do tráfego e das interações na internet passa a ser não humana, e a linha entre conversação e ação se estreita, porque os agentes não apenas falam — eles executam.

Como economista e estrategista de mercado, observo este movimento com a mesma atenção que se dedica à calibragem de uma transmissão de alto desempenho: a tecnologia avança com aceleração, mas sem os freios adequados — normas, permissões e controles — o risco sistêmico ganha velocidade. Para empresas, reguladores e investidores, o desafio imediato é projetar freios institucionais e arquiteturas de segurança que administrem essa nova topologia digital antes que erros e ataques convertam experimentos em externalidades severas para o mercado.